단일 클라우드 또는 데스크톱 가속기에서 실행할 수 있는 최첨단 개방형 모델 제품군인 Gemma 3 및 Gemma 3 QAT의 출시 후, Google은 접근 가능한 AI에 대한 비전을 더욱 발전시키고 있습니다. Gemma 3는 개발자를 위한 강력한 기능을 제공했으며, 이제 그 비전을 사용자가 매일 사용하는 휴대폰, 태블릿, 노트북 등 기기에서 바로 작동하는 고성능 실시간 AI로 확장하고 있습니다.

차세대 온디바이스 AI를 구동하고 Gemini Nano의 기능을 발전시키는 등 다양한 애플리케이션을 지원하기 위해, Google은 새로운 최첨단 아키텍처를 설계했습니다. 이 차세대 기반은 Qualcomm Technologies, MediaTek, 삼성 시스템LSI와 같은 모바일 하드웨어 선도업체와의 긴밀한 협력을 통해 만들어졌으며, 초고속 멀티모달 AI에 최적화되어 개인적인 비공개 경험을 기기에서 바로 지원합니다.

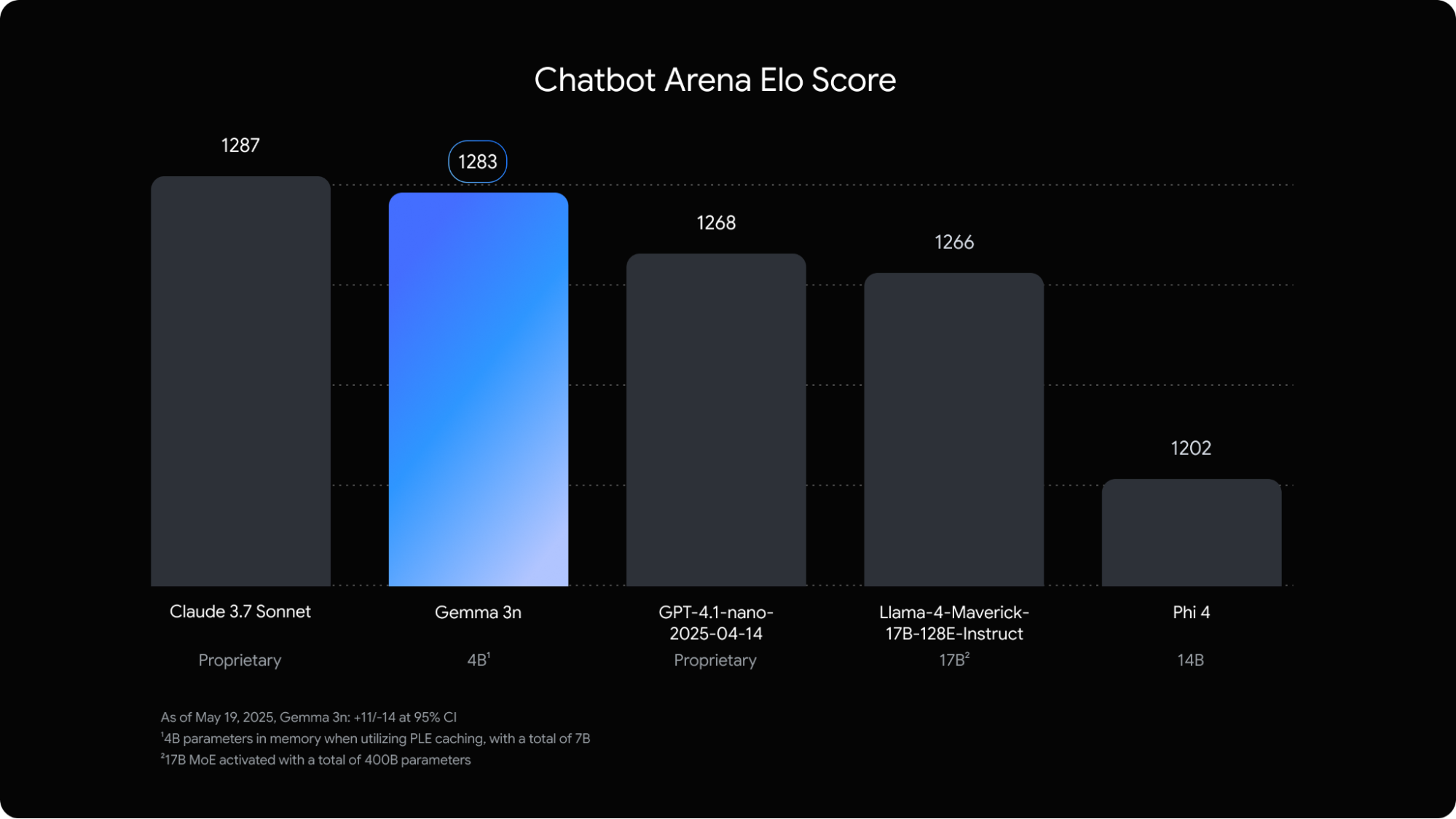

Gemma 3n은 이 획기적인 공유 아키텍처를 기반으로 구축된 최초의 개방형 모델로, 개발자는 지금 바로 초기 미리보기를 통해 이 기술을 실험해 볼 수 있습니다. 이것과 동일한 고급 아키텍처는 차세대 Gemini Nano에도 적용되어 Google 앱과 온디바이스 생태계의 다양한 기능에 이러한 기능을 제공하며 올해 말 제공될 예정입니다. Gemma 3n을 사용하면 Android 및 Chrome과 같은 주요 플랫폼에 제공될 이 기반 위에서 개발을 시작할 수 있습니다.

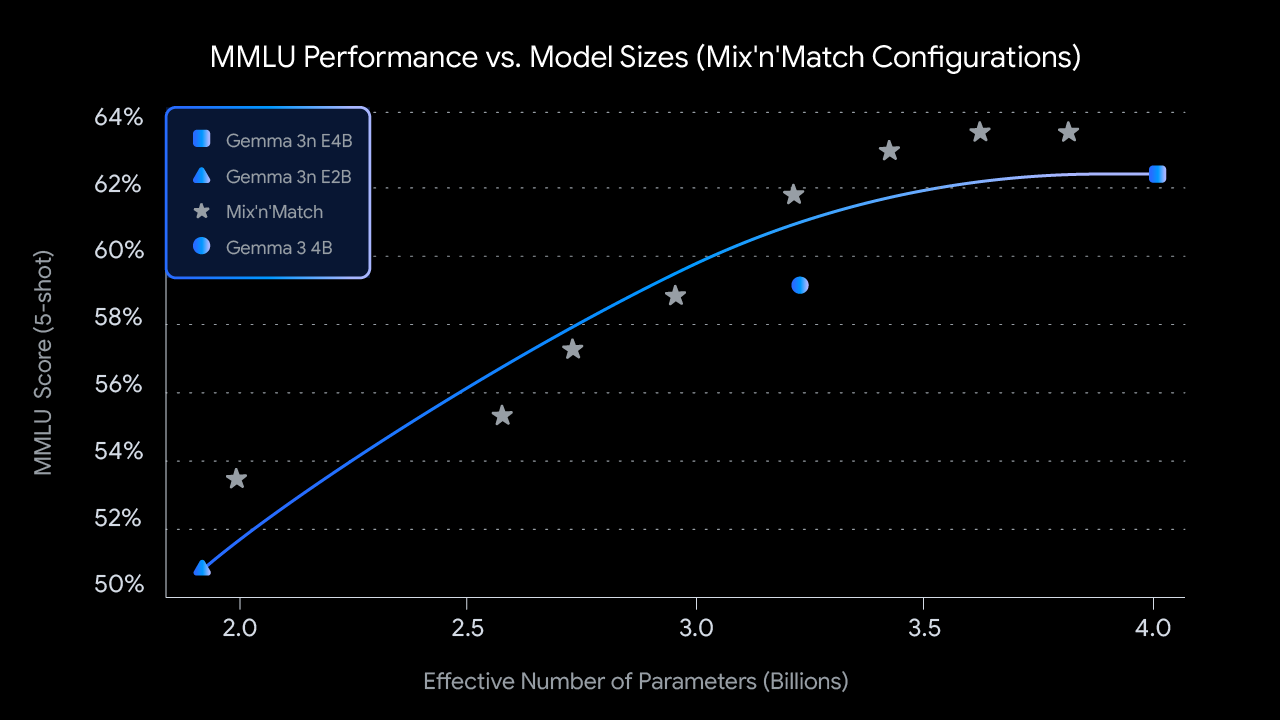

Gemma 3n은 RAM 사용량을 크게 줄여주는 레이어별 임베딩(PLE)이라는 Google DeepMind의 혁신 기술을 활용합니다. 원시 파라미터 수는 5B와 8B이지만, 이 혁신을 통해 모바일 기기에서 더 큰 모델을 실행하거나 클라우드에서 라이브 스트리밍할 때 메모리 오버헤드가 2B와 4B 모델과 비슷해져 2GB와 3GB의 동적 메모리 사용량만으로 모델을 작동할 수 있습니다. 자세한 내용은 설명서에서 확인하세요.

개발자는 Gemma 3n을 살펴봄으로써 Gemini Nano를 통해 Android 및 Chrome에서 사용할 수 있는 개방형 모델의 핵심 기능과 모바일 우선 아키텍처의 혁신 기술을 미리 살펴볼 수 있습니다.

이 게시물에서는 Gemma 3n의 새로운 기능, 책임 있는 개발에 대한 접근 방식, 지금 바로 미리보기를 이용할 수 있는 방법을 살펴봅니다.

로컬에서 실행되는 빠르고 사용량이 적은 AI 경험을 위해 설계된 Gemma 3n은 다음과 같은 기능을 제공합니다.

Gemma 3n은 개발자가 다음과 같이 하도록 지원하여 즉각적인 지능형 애플리케이션의 새로운 물결을 일으킬 것입니다.

2. 오디오, 이미지, 동영상, 텍스트 입력을 결합하여 더 깊은 이해와 문맥에 맞는 텍스트 생성을 강화합니다(모두 기기에서 비공개로 처리됨).

3. 실시간 음성 스크립트 작성, 번역, 풍부한 음성 중심 상호작용을 포함한 고급 오디오 중심 애플리케이션을 개발합니다.

개요 및 구축할 수 있는 경험의 유형은 다음과 같습니다.

Link to Youtube Video (visible only when JS is disabled)

책임감 있는 AI 개발을 위한 Google의 노력은 매우 중요합니다. Gemma 3n은 모든 Gemma 모델과 마찬가지로 엄격한 안전성 평가, 데이터 거버넌스, 안전 정책에 따른 미세 조정을 거쳤습니다. Google은 신중한 위험 평가를 통해 개방형 모델에 접근하며, AI 환경이 진화함에 따라 지속적으로 관행을 개선하고 있습니다.

오늘부터 미리보기를 통해 Gemma 3n을 만나볼 수 있습니다.

초기 액세스(지금 사용 가능):

Gemma 3n은 효율적인 최첨단 AI에 대한 액세스를 대중화하기 위한 다음 단계입니다. 오늘 미리보기를 시작으로 이 기술을 점진적으로 제공함에 따라 어떤 결과물을 만들어내실지 아주 기대됩니다.

5월 22일부터 io.google에서 이 발표와 모든 Google I/O 2025 업데이트를 살펴보세요.